论文|元宇宙研究中心成果被CCF B类国际会议IEEE ISMAR2022录用

发布时间:2022-10-17近期,中国人民大学与百度增强现实技术部合作的关于移动设备上的增强现实中虚拟试鞋系统的研究被2022年混合和增强现实国际研讨会(ISMAR)长文录用。ISMAR是混合和增强现实领域的国际顶级学术会议。这篇文章是由中国人民大学与百度增强现实技术部(ART)共同合作完成。论文一作是来自中国人民大学信息学院INLAB实验室的宋文爽(2020级硕士生),该论文由中国人民大学王永才以及百度高级研发工程师宫延河共同指导完成的。

论文题目:

VTONShoes: Virtual try-on of shoes in augmented reality on a mobile Device

论文作者:

宋文爽,宫延河,王永才

通讯作者:王永才

研究背景:

近年来,增强现实(AR)中的虚拟试穿系统引起了广泛的研究兴趣。电商领域的移动AR技术,如虚拟试表、虚拟试镜以及虚拟试鞋等自拍式引导的AR购物方式已为用户带来了全新的网购体验。在虚拟购物的过程中,用户希望看到虚拟试穿产品在不同角度的沉浸感试穿效果。这种方法需要在屏幕上渲染一个3D模型,以给用户带来沉浸式的购物体验。目前对虚拟试鞋的研究仍然存在一些挑战。例如,当两只鞋子相互遮挡或自遮挡时,不能准确的估计鞋子的位姿,以及不能覆盖一些具有挑战性场景的姿态估计,例如,相机快速移动以及对于截断的处理。本文介绍了一种新型的实时AR虚拟试鞋系统(VTONShoes),用户可以在移动设备上实时准确的体验沉浸式的全自由度虚拟试鞋效果。

解决方案:

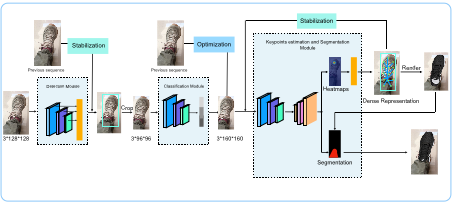

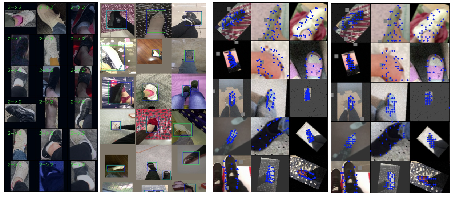

在本文中,我们首次提出了一个有效的多阶段网络框架(VTONShoes),包括从捕获的图像中对鞋子区域进行检测、左右脚分类和估计鞋子的六自由度姿态,并准确的在屏幕上实时渲染出鞋子的三维模型。为了实现精确的姿态估计,我们在三维鞋子模型上设计了一种关键点的特殊密集表示。同时设计了一种高效的二维关键点定位联合腿部轮廓分割模块(KeyPointLoc),用于预测关键点在二维图像上的投影以及鞋子与腿间的遮挡关系。进一步的。为了减少帧间抖动,我们提出了一种基于优化的最长连续不变子数组优化算法,以减少由于左右脚分类错误引起的鞋子三维模型频繁切换问题。并提出了一个指数权值衰减平滑模块对渲染结果进行平滑后处理。我们还提出了一个名为Diversity - Shoes的大型鞋子数据集,其中包含从80K段视频中提取的多样化鞋子图像,并标注了鞋子检测框、左右脚分类、变换矩阵以及腿部轮廓。实验表明,我们的框架在主流设备上实现了平滑稳定的虚拟试穿效果,在主流移动设备上的实时速度约为25 - 45 FPS,这在实时性能和渲染精度方面明显优于最先进的方法。

图1. 系统结构图

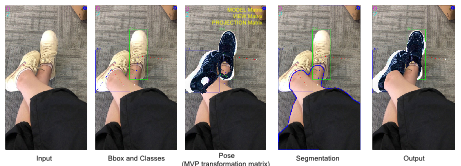

图2. 鞋子目标检测与图像分割

图3. 基于3D-2D特征点匹配的鞋子3D位姿计算

图4. 虚拟试鞋效果

论文信息:

Wenshuang Song, Yanhe Gong, Yongcai Wang. “VTONShoes: Virtual try-on of shoes in augmented reality on mobile device”. IEEE International Symposium on Mixed and Augmented Reality. ISMAR 2022.

作者简介:

宋文爽,中国人民大学信息学院2020级硕士生,导师为王永才,她的研究方向为三维重建与物体6-DoF姿态估计。

宫延河,时任百度人工智能技术体系增强现实技术部(ART)高级研发工程师。

王永才,中国人民大学信息学院副教授、中国人民大学元宇宙研究中心研究员,主要研究方向为大规模图结构挖掘与计算、智能物联网的感知、定位、建图算法与应用